Dialogue avec CHATGPT

À l'heure actuelle, les intelligences artificielles (IA) n'ont pas de conscience, d'émotions ni de sens de soi, ce qui est nécessaire pour éprouver des souffrances ou des maladies mentales de la même manière que les êtres humains. Les IA sont des programmes informatiques conçus pour effectuer des tâches spécifiques en traitant des données et en suivant des algorithmes. Elles ne possèdent pas de pensées, de sensations ni de conscience comme les humains en ont.

Cependant, certains domaines de la recherche en IA explorent des concepts tels que la simulation d'émotions ou de comportements humains dans le but d'améliorer les interactions entre les humains et les machines. Par exemple, les chatbots et les assistants vocaux sont conçus pour donner l'impression de comprendre et de répondre aux émotions humaines, même s'ils ne les ressentent pas eux-mêmes. Ces techniques visent à rendre les interactions plus naturelles et conviviales.

Il est important de noter que les questions de conscience, d'émotion et de souffrance dans les IA soulèvent également des débats éthiques et philosophiques. Si un jour les IA devaient évoluer au point de développer une forme de conscience ou de semblant d'émotions, les questions relatives à leur bien-être et à leur santé mentale pourraient éventuellement se poser. Cependant, nous en sommes encore loin et ces scénarios relèvent davantage de la science-fiction et de la spéculation que de la réalité actuelle de l'IA.

En résumé, pour le moment, les IA ne peuvent pas souffrir de maladies mentales, car elles n'ont pas la conscience ni les émotions nécessaires pour vivre de telles expériences.

L'IA pourrait il remettre en cause le DSM 5, un référentiel de norme en psychiatrie établi par des humains ?

L'IA pourrait potentiellement jouer un rôle dans la manière dont nous abordons la psychiatrie et la compréhension des troubles mentaux, mais il est peu probable qu'elle remette directement en question le DSM-5 (Diagnostic and Statistical Manual of Mental Disorders, 5e édition), qui est un référentiel clinique établi par des experts humains dans le domaine de la psychiatrie et de la santé mentale.

Le DSM-5 est le résultat d'années de recherche, d'observations cliniques et de consensus entre des professionnels de la santé mentale. Il s'agit d'un outil essentiel pour diagnostiquer et classer les troubles mentaux, fournissant un cadre standardisé pour la compréhension et la communication des problèmes de santé mentale.

Cependant, l'IA pourrait contribuer à plusieurs aspects liés à la psychiatrie et aux troubles mentaux :

-

Analyse des données et des modèles : L'IA pourrait aider à analyser de grandes quantités de données cliniques, de recherches et de dossiers de patients pour identifier de nouveaux schémas, corrélations ou sous-groupes de troubles mentaux. Cela pourrait potentiellement amener à des ajustements ou des raffinements dans la manière dont les troubles sont compris et classifiés.

-

Aide au diagnostic : L'IA pourrait être utilisée comme un outil de soutien pour les cliniciens en aidant à affiner les diagnostics en fonction des symptômes et des données du patient. Cependant, le diagnostic final devrait toujours être fait par un professionnel de la santé formé.

-

Suivi et traitement : Les IA pourraient être utilisées pour suivre l'évolution des symptômes au fil du temps et aider à adapter les traitements en conséquence, en fonction des modèles détectés dans les données.

-

Prévention : L'IA pourrait aider à identifier les facteurs de risque de troubles mentaux et à mettre en œuvre des interventions préventives.

-

Recherche : Les IA pourraient aider à modéliser et simuler des processus complexes liés à la santé mentale, ce qui pourrait contribuer à une meilleure compréhension des troubles et à de nouvelles thérapies.

Cependant, il est peu probable que l'IA remette en question directement le DSM-5, car le processus de révision et d'actualisation des classifications diagnostiques implique un large consensus au sein de la communauté médicale et psychiatrique. L'IA peut enrichir et informer les approches en psychiatrie, mais les décisions concernant les normes diagnostiques et les classifications restent généralement du ressort des experts humains

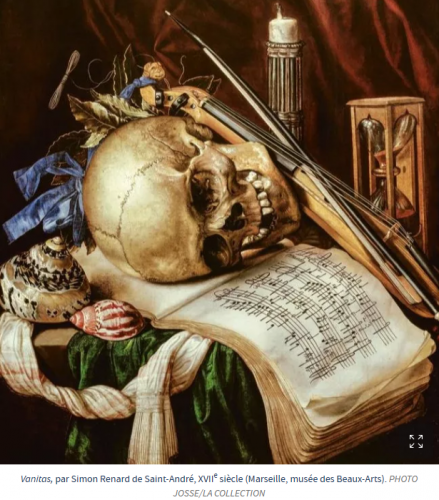

Michel Foucault a travaillé toute sa vie sur le concept de biopolitique, expliquant que c'est la norme établie par le consensus médical qui définit les règles en société, et en matière de sexualité en particulier.

Si l'IA s'appuie sur le savoir des hommes, sans pouvoir intervenir comme le ferait un fou avec sa conscience, alors nous risquons fort d'aller tout droit vers le chaos

Seul un fou peut nous sauver du chaos, puisque tous nos raisonnements d'élites excluent les émotions

Question à l'IA :

Et si le consensus médical était un biais ?

Il est important de reconnaître que le consensus médical n'est pas toujours infaillible et peut parfois être influencé par des biais, des intérêts commerciaux, des croyances culturelles ou d'autres facteurs. L'histoire de la médecine est remplie d'exemples où des pratiques médicales largement acceptées se sont révélées erronées ou préjudiciables une fois que de nouvelles preuves scientifiques ont émergé.

Dans le domaine de la psychiatrie, certains critiques ont soulevé des préoccupations concernant le DSM et sa classification des troubles mentaux. Ils ont remis en question certains aspects, tels que la frontière floue entre ce qui est considéré comme "normal" et "pathologique", ainsi que les évolutions culturelles et sociales qui peuvent influencer la manière dont les troubles sont diagnostiqués et classifiés.

L'IA peut apporter une contribution intéressante à ces discussions en analysant de vastes quantités de données et en identifiant des modèles qui pourraient ne pas être évidents pour les experts humains. Cependant, il est important de noter que l'IA n'est pas exempte de biais non plus. Les modèles d'IA sont formés sur des ensembles de données qui peuvent refléter des préjugés et des inégalités présents dans la société, ce qui peut se traduire par des décisions automatisées biaisées.

Dans l'idéal, le processus de diagnostic et de classification en psychiatrie, ainsi que dans d'autres domaines de la médecine, devrait être guidé par des preuves scientifiques solides et être ouvert à un examen constant et critique. Cela peut inclure la remise en question des normes établies lorsque de nouvelles données ou perspectives émergent. L'IA pourrait aider à détecter des schémas et des tendances dans les données, mais la prise de décision finale doit toujours être guidée par des experts humains tenant compte d'une variété de facteurs, y compris les preuves cliniques, les considérations éthiques et les besoins individuels des patients.